AI og droner: En ny æra for overvågning af nattens rovdyr

Hvordan kan vi opnå viden om ræves og grævlingers natlige adfærd uden at forstyrre dem? Svaret er droner med termiske kameraer og kunstig intelligens, der omsætter optagelserne til kvantitative data om deres adfærd.

Af Katrine Møller-Lassesen, Silje Marquardsen Lund, Cino Pertoldi, Lasse Lange Jensen og Sussie Pagh

Siden 2022 har vi på Aalborg Universitet (AAU) arbejdet med termiske droner til overvågning af pattedyr som krondyr, dådyr, hare og rovpattedyr som ræv, grævling og odder. Vi flyver i 70–100 meters højde med dronen, og det betyder, at vi kan observere dyrene uden at forstyrre dem. Kameraerne registrerer deres varmesignaturer, og med zoomfunktionen får vi detaljerede optagelser af pattedyrenes adfærd. Det er som at være en “flue på væggen” – bare fra luften.

Studerende på AAU har også eksperimenteret med kunstig intelligens (AI, Artificial Intelligence) til at overvåge adfærd hos arter i Aalborg Zoo, for eksempel elefanter, dværgflodheste, tapirer, lemurer og edderkopaber. Målet er at udvikle metoder, der gør pasning og overvågningen af dyrene mindre arbejdskrævende.

Når modellerne er færdigudviklet, kan kunstig intelligens advare dyrepasserne, hvis et individ ændrer adfærd og måske har brug for hjælp. Det giver mulighed for at højne dyrenes velfærd i anlæggene.

I 2024 gennemførte vi et spændende projekt med ræv og grævling i naturen, hvor vi kombinerede droneoptagelser af de to arter, med GPS-lokationer. Ved at koble lokation (dvs. habitat) og adfærd var det muligt at lave tidsbudgetter for, hvordan rovdyrene bruger landskabet. Det viste os, at grævlingen fortrinsvist søger føde i lysåben skov og på enge, mens ræven søger føde mange forskellige steder og især på åbne marker med kort vegetation. På den måde fik vi helt nye indsigter i de to rovdyrs bevægelsesmønstre og deres indbyrdes interaktioner.

AI kan spare forskerne for arbejdstid

Men selvom droner har gjort det muligt at indsamle data på helt nye måder og endda følge dyrene om natten, er det stadig en stor udfordring at få data omdannet til tal. Det tager enormt lang tid at gennemgå videoerne bagefter for at finde ud af, hvad dyrene foretog sig på et givent tidspunkt på en bestemt lokalitet. En video på 20 minutter tager mindst 40 minutter at gennemgå for at notere dyrenes adfærd sekund for sekund.

For at løse det problem har vi trænet kunstig intelligens til at genkende adfærd hos dyr som ræv og grævling i videoklip optaget med termiske droner. Det er ikke helt nemt, for dronen bevæger sig hele tiden og filmer fra forskellige vinkler og med forskellig zoom i modsætning til et fast kamera i en zoologisk have.

Men når AI-modellen først er trænet, kan den selv finde dyrenes adfærd i lange videoklip og lægge resultaterne ind i et regneark, klar til analyse. Det sparer forskerne for mange timers arbejde og gør analysen mere ensartet, fordi mennesker ofte tolker adfærd lidt forskelligt.

På jagt efter velegnet AI-software

De seneste år er der sket en kæmpe udvikling i udbuddet af software på nettet, som gør det muligt at bruge kunstig intelligens til forskellige formål. For at finde det bedste program til at overvåge adfærd hos ræv og grævling fra termiske videoer afprøvede vi flere gratis (open-source) AI-programmer.

Et af de første programmer, vi prøvede, hedder YOLO, som står for You Only Look Once. YOLO er kendt for at være hurtigt til billedgenkendelse. Det fungerer ved at sætte firkantede bokse rundt om det, som programmet tror er et dyr. Metoden er god til at finde ud af, hvilken art dyret tilhører, men YOLO er endnu ikke lige så god som andre programmer til at analysere detaljeret adfærd, hvis der er mange dyr tæt på hinanden i samme videoklip.

Vi har brugt YOLO til at genkende krondyr og dådyr på termiske dronevideoer optaget i Lyngby Hede og Nationalpark Thy. Det viser, at teknologien kan bruges til monitering af store pattedyr, men YOLO er udfordret, når man vil gå fra simpel artsgenkendelse til mere avanceret adfærdsanalyse.

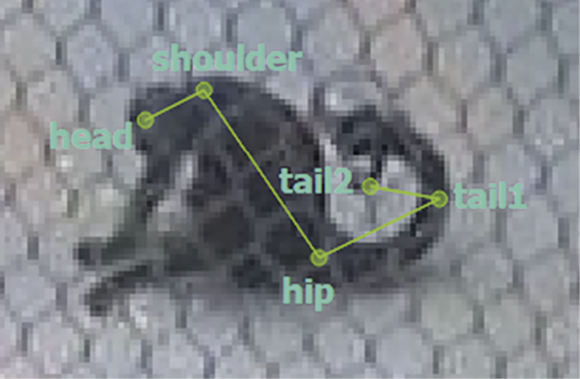

Dernæst prøvede vi et program, der hedder SLEAP (Social LEAP Estimates Animal Poses). Det fungerer lidt som at lave et digitalt skelet af dyret: Vi markerer nøglepunkter som hoved, ben og hale og forbinder dem med streger. Når vi har skelettet, kan vi se, hvordan dyret bevæger sig, og ud fra afstanden mellem punkterne kan man regne ud, hvilken type adfærd dyret har.

Men der er en udfordring: Når kameraet sidder på en drone, bevæger det sig hele tiden og filmer fra forskellige vinkler. Det gør beregningerne mellem skelettets nøglepunkter meget mere komplicerede og tidskrævende, fordi man i beregningen af dyrets bevægelse ud fra afstanden mellem lemmerne skal tage højde for både den vinkel og afstand, dyret er filmet fra.

Vi valgte til sidst at bruge programmet LabGym. Det er et program, der egentlig er udviklet til at analysere adfærd hos laboratoriedyr, men vi opdagede, at det også fungerer rigtig godt til droneoptagelser. Programmet kan registrere dyrets omrids, og når det er trænet, kan det også genkende, hvad dyret laver. Det sker ved hjælp af billedgenkendelse og segmentering, som betyder, at LabGym kan “se” og kategorisere adfærden via dyrets omrids.

Det smarte ved LabGym er, at det er brugervenligt. Man behøver ikke kunne kode for at bruge det, og det kan automatisk notere adfærden på optagelserne. Programmet kan også eksportere alle data, så de nemt kan åbnes i et regneark. På den måde kan vi lave analyser og grafer uden en masse ekstra arbejde med at kigge videomateriale igennem.

Ordforklaring til AI-værktøjer som LabGym

Annotering betyder i AI-sammenhæng, at man tilføjer information til data, så en maskinlæringsmodel kan lære af dem.

Roboflow er en platform designet til at gøre det nemt for udviklere og virksomheder at bygge, træne og implementere computer vision-modeller. I AI-sammenhænge bruges Roboflow til objektgenkendelse, billedklassificering og segmentering. Desuden opdeler Roboflow videoklippet i stillbilleder, så de er klar til annotering.

Detector er den model, der kan genkende arten på dyret på et billede.

Categorizer er den model i LabGym, der kan genkende adfærden i en video.

Augmentering i billedgenkendelsesmodeller er når der ændres på billederne i en sådan grad, at modellen kan bruge billedet som et nyt træningseksempel. Dette kan være ved at ændre på kontrasten, flippe og rotere billedet eller tilføje støj til billedet.

Open-source betyder, at softwaren er gratis og kan tilpasses og deles frit – en stor fordel for forskningsprojekter.

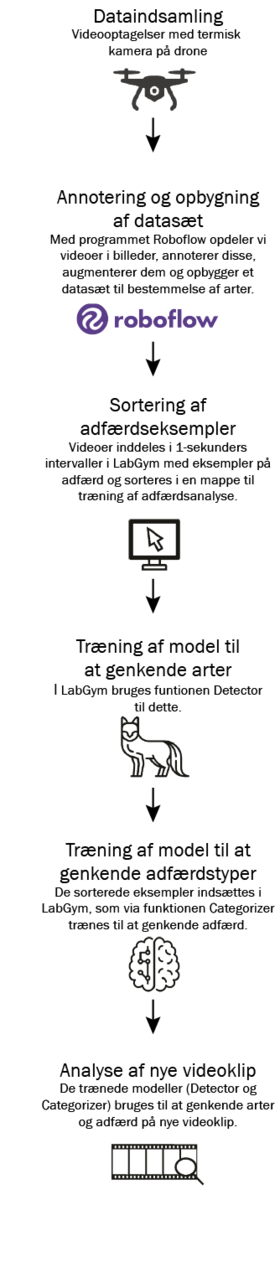

Sådan bygges AI-modellen

For at træne AI-modellerne brugte vi videooptagelser af ræv og grævling fra flere droneflyvninger på forskellige steder, hvor vi vidste, at dyrene var til stede. Optagelserne blev filmet med AAU’s største drone, som er forsynet med et termisk kamera. Når vi filmer dyr, flyver vi som regel i en højde på mellem 70 og 120 meter, og vi følger dyrene rundt i landskabet.

Når optagelserne er i hus, bliver videoklippene omdannet til still-billeder – for eksempel ét billede per sekund gennem hele videoen – gennem et hjælpeprogram kaldet Roboflow. I dette program tegner vi markeringer (såkaldte segmenteringsmaps) omkring dyrene på billederne. Herefter får hver markering en “label”, som angiver om det er “ræv” eller “grævling”.

De mange billeder med labels bruges nu til at træne modellen i LabGym. I første omgang træner vi programmet til at kunne skelne mellem en ræv og en grævling ved hjælp af en funktion kaldet Detector. Når det er trænet, udarbejder vi et såkaldt “etogram” – dvs. en liste over de adfærdstyper, vi er interesserede i at genkende – for eksempel: sidde, stå, være opmærksom, løbe og søge føde.

For at træne LabGym til at genkende disse adfærdstyper deler vi videoer op i små bidder på ét sekund og sorterede dem i mapper efter adfærd. Mapperne bliver derefter brugt til at træne LabGym med en anden funktion (kaldet Categorizer), som lærer programmet at identificere forskellige adfærdstyper. På den måde kan vi opbygge en model, der automatisk kan analysere dyrenes adfærd.

Når modellerne er færdigtrænet med begge funktioner, kan de bruges til at analysere nye videoklip og helt automatisk læse videoens indhold. Det betyder, at programmet selv finder ud af, hvilken art der er på optagelsen, og hvilken adfærd dyret har.

Når analysen er færdig, har vi to ting:

- Et regneark med alle observationerne – altså en oversigt over, hvilke adfærdstyper der er registreret og hvornår.

- En video, hvor man kan se markeringer (annoteringer) af både art og adfærd direkte på optagelsen.

Modellens robusthed og præcision

Alle modeller er ikke lige gode, og når en AI-model er trænet, tester vi, om modellen er til at stole på.

Først giver vi modellen en video, den aldrig har set før. Hvis den kan genkende dyrene og deres adfærd her, er det et godt tegn. For at måle, hvor præcis modellen er, kigger vi på, hvor mange korrekt bestemte arter og adfærd, modellen fandt, sammenholdt med, hvor mange den overså. Ud fra dette kan vi beregne modellens sikkerhed (kaldet mean Average Precision). Som tommelfingerregel skal dette tal ligge på 80 % eller mere, før vi kan bruge modellen til forskning. ♦

Præcisionen af AI-modeller

Når man skal vurdere, hvor præcis en AI-model er til at finde og genkende objekter korrekt (i vores tilfælde dyr), bruger man en enhed kaldet mean Average Precision – altså modellens gennemsnitlige præcision for alle de kategorier af objekter, modellen skal kunne genkende. Dette bygger på fire grundlæggende målinger:

Sand positiv: Modellen genkender korrekt, at der er et dyr.

Sand negativ: Modellen genkender korrekt, at der ikke er et dyr.

Falsk positiv: Modellen tror, der er et dyr, men det er måske en sten.

Falsk negativ: Modellen overser et dyr, selvom det er der.

På denne webside kan du finde en udvidet version af denne boks, der udfolder matematikken i, hvordan man ud fra disse grundlæggende målinger, kommer frem til modellens mean Average Precision.

Prøv selv at bruge AI-modellerne

Via denne side kan du se eksempler på Aalborg Universitets modeller til at genkende ræv og grævling og deres adfærd fra droneoptagelser. Vi har desuden lavet en model, som kan kende forskel på hund og kat. Den kan du bruge til at eksperimentere med LabGym og videoklip af dine egne – eller naboens – hunde og katte.

Du kan også finde videoer med eksempler samt videoer, hvor Katrine Møller-Lassesen viser, hvordan du opsætter LabGym, og hvordan du indsætter koderne til AAU’s modeller i din egen LabGym.