Ekstramateriale til artiklen: AI og droner...

Til højre finder du en række videoer fra Aalborg Universitet

(nederst på siden, hvis du er på en lille skærm).

Sådan tester man præcisionen af en AI-model:

For at kunne vurdere, hvor præcis en AI-model er til at finde og genkende objekter korrekt, bruger man en måleenhed kaldet mean average precision (mAP). Den bygger på fire grundlæggende målinger, som I vores model til at genkende dyr (ræv og grævling) er:

- True Positive (TP): Modellen genkender korrekt, at der er et dyr.

- True Negative (TN): Modellen genkender korrekt, at der ikke er et dyr.

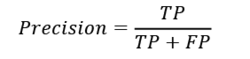

- False Positive (FP): Modellen tror, der er et dyr, men det er måske en sten.

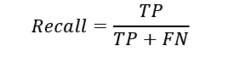

- False Negative (FN): Modellen overser et dyr, selvom det er der.

Derudover bruges følgende begreber:

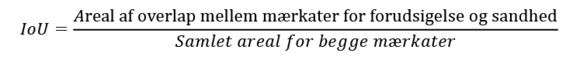

- Intersection over Union (IoU): Måler hvor godt modellens markering af et dyr stemmer overens med den korrekte placering.

- Average precision (AP): Viser forholdet mellem Recall og Precision (se nedenfor)

Klasser (N): En kategori af objekt, for eksempel ræv eller grævling.

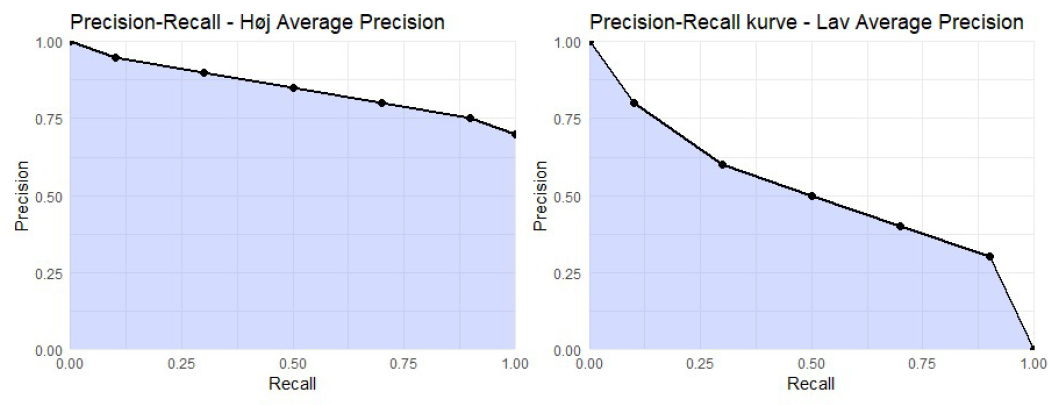

Man sætter precision og recall for forskellige IoU-tærskler på en kurve, kaldet “Precision Recall curve”. Et stort areal under kurven viser, at modellen har en stærk Recall og Precision, mens et lille areal viser en svag Recall og Precision. Dette areal giver AP (se figuren nedenfor).

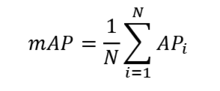

mAP udregnes til sidst ved at tage gennemsnittet af AP for alle klasser, N.

mean average precision (mAP) udregnes med følgende formel: